Databricks Revoluciona a Busca Empresarial com KARL

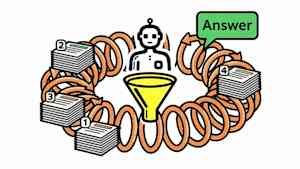

Em um cenário onde a maioria das pipelines de RAG (Geração de Respostas Automatizadas) estão otimizadas para um único comportamento de busca, a Databricks inova com o KARL (Knowledge Agents via Reinforcement Learning). Esta nova abordagem busca resolver as falhas silenciosas das soluções tradicionais ao lidar com comportamentos de busca complexos.

O Desafio das Buscas Empresariais

Modelos de busca tradicionais enfrentam dificuldades quando se deparam com tarefas complexas, como a síntese de relatórios a partir de múltiplos documentos ou buscas de entidades orientadas por restrições. A Databricks desenvolveu o KARL utilizando um algoritmo de aprendizado por reforço que permite ao agente lidar com seis comportamentos distintos de busca empresarial simultaneamente.

O resultado é um modelo que, segundo a companhia, iguala o desempenho do Claude Opus 4.6 em um benchmark específico, mas a um custo 33% menor por consulta e com 47% menos latência. Tudo isso utilizando dados sintéticos gerados pelo próprio agente, sem necessidade de rotulação humana.

Desafios do Aprendizado por Reforço em Ambiente Empresarial

Jonathan Frankle, cientista-chefe de IA da Databricks, destaca que muitas tarefas empresariais não possuem respostas verificáveis de forma simples. Essas tarefas incluem desde a síntese de inteligência em notas de reuniões de gerentes de produto até a reconstrução de resultados de negócios competitivos a partir de registros fragmentados.

O grande desafio é aplicar aprendizado por reforço em contextos onde não há uma resposta certa ou errada facilmente identificável. Isso exige um processo de guia cuidadoso para evitar problemas como o hacking de recompensas.

O Benchmarking e as Capacidades do KARL

Para avaliar o KARL, a Databricks criou o KARLBench, um benchmark que mede o desempenho em seis comportamentos de busca empresarial. Esses incluem:

- Busca de entidades orientada por restrições

- Síntese de relatórios entre documentos

- Travesseiro de documentos longos com raciocínio numérico tabular

- Recuperação exaustiva de entidades

- Raciocínio procedimental sobre documentação técnica

- Agregação de fatos sobre notas internas

O KARL foi treinado com dados sintéticos em dois dos seis comportamentos e demonstrou bom desempenho nos demais, destacando sua capacidade de generalização.

O Papel do OAPL na Eficiência do KARL

KARL é alimentado pelo OAPL (Optimal Advantage-based Policy Optimization with Lagged Inference policy), uma abordagem desenvolvida em parceria com pesquisadores de Cornell, Databricks e Harvard. Essa técnica abraça a natureza off-policy do treinamento distribuído, garantindo estabilidade mesmo com grandes atrasos de política.

OAPL permite que a eficiência de amostra do KARL mantenha os custos de treinamento acessíveis, utilizando anteriormente coletados em vez de dados frescos a cada atualização.

Memória Contextual e Compressão de Dados

No debate sobre substituir RAG por memória contextual, Frankle vê isso como uma pilha em camadas. A base é um banco de dados vetorial com milhões de entradas, enquanto a janela de contexto do LLM fica no topo. Entre eles, camadas de compressão e cache determinam o quanto do que um agente aprendeu pode ser levado adiante.

No caso do KARL, tarefas exigiam até 200 consultas sequenciais ao banco de dados vetorial. Em vez de treinar um modelo de sumarização separado, KARL aprendeu a compressão de ponta a ponta por meio do RL, melhorando significativamente a precisão.

Conclusão

Embora o KARL demonstre avanços significativos, ainda enfrenta desafios, especialmente em perguntas com alta ambiguidade ou onde múltiplas respostas válidas existem. A Databricks continua a desenvolver suas capacidades, mirando em futuros avanços que incluam suporte a consultas SQL e cálculos baseados em Python.

Para equipes empresariais, o KARL destaca a importância de reavaliar a arquitetura de pipelines de busca e considerar o aprendizado por reforço como uma ferramenta poderosa para lidar com dados diversos e consultas imprevisíveis.